Introduction

양파, 마늘은 우리 식단에서 가장 중요한 양념 채소들 중 하나이다. 그러나 이들 품목은 주기적인 수급 불안 발생으로 물가 및 농가 소득의 안정적 유지에 어려움을 겪고 있는 대표적인 품목들이다 (Cho et al., 2014). 농산물 가격은 기상, 재배면적, 병충해 발생 등 생산 환경 변화, 유통 구조, 소비 경향 등 시장 환경 변화뿐 아니라 기타 다양한 요인에 영향을 받는다. 이 중에서도 재배면적은 생산량 변동 예측과 수급대책 수립을 위해 기초적으로 산정되어야 할 필수적인 통계자료이다.

기존의 양파, 마늘 재배면적 조사는 설문을 통한 재배의향 조사 또는 표본 필지에 대한 현장 조사 (통계청)를 통해 수행되고 있다. 그러나 재배의향 조사의 경우 파종, 정식기의 농업인 의향 변화에 따라 실제 재배면적과는 차이가 있으며, 표본 조사의 경우도 인력을 활용한 조사로서 전수 조사에 비해 시간 및 비용 절감에 효과적이지만 소수의 표본을 통해 전체 모집단의 특성을 추정해 내는 것이므로 그 표본이 전체 모집단을 잘 대표할 때는 효과적으로 사용될 수 있지만 그렇지 않을 때는 문제가 생길 수 있다.

최근 들어 급속하게 발전하고 있는 무인기 (UAV : Unmanned Aerial Vehicle) 기술에 힘입어 고해상도 위성 및 항공 영상의 농업분야 활용이 증가하고 있다 (Lee et al., 2015; Na et al., 2016; Yoon et al., 2016). 1~10 m 내외의 해상도를 갖는 기존 위성영상으로는 수행하기 어려웠던 복잡한 구조와 소규모 면적의 농경지 작물 구분도 무인기 기술 발전에 따라 10 cm 이하의 고해상도 영상을 손쉽게 얻게 되면서 육안 판독으로도 높은 정확도로 분류가 가능하게 되었다 (Park et al., 2016). 그러나 육안 판독을 통한 영상 분류는 조사자별 주관 및 숙련도에 따른 오차가 존재할 뿐 아니라 시·군 단위 이상의 대규모 면적에 대한 신속한 작업 수행에도 한계가 있음으로 자동 분류 방안에 대한 검토가 필요하다

양파, 마늘의 재배면적은 2015년 기준 통계청 경지 총 조사 결과 각각 15,412 ha, 19,317 ha이었는데, 상위 10개 주산지 시, 군의 재배면적 비율이 65.6%, 60.7%를 차지하여 (Kosis, 2016) 생산량 변동에 미치는 주산지의 영향력이 매우 클 것으로 판단된다.

따라서, 본 연구는 양파, 마늘 주산지에 대한 무인기 영상의 감독분류 기법 및 시기별 분류 정확도를 평가하여 양파, 마늘 재배면적 산정을 위한 무인기 영상의 자동 분류 기법 적용 가능성 평가를 위해 수행하였다.

Materials and Methods

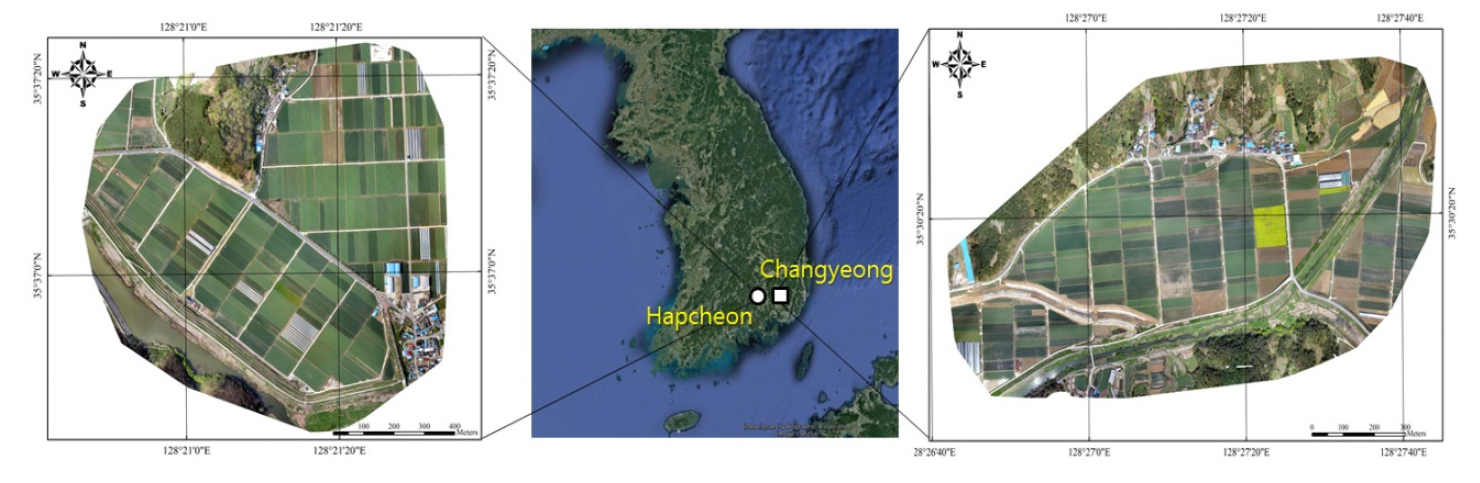

연구대상 지역 연구 대상지역은 양파, 마늘 주산지인 경남 합천군 덕곡면 초계리 일원 (35°37′08″N, 128°21′27″E)과 창녕군 유어면 풍조리 일원 (35°30′18″N, 128°27′12″E)으로 선정하였다 (Fig. 1 ). 2015년 기준 창녕군의 양파, 마늘 재배면적은 각각 1,035 ha, 2,194 ha로 양파의 경우 전국 4위, 마늘의 경우 전국 1위를 기록했다. 합천군의 경우 양파, 마늘 재배면적이 각각 1,138 ha, 743 ha로 양파의 경우 전국 3위, 마늘의 경우 전국 10위를 기록하여 창녕군과 합천군 모두 양파와 마늘의 재배면적이 전국 10위 안에 드는 주요 주산지이다. 연구 대상지역은 하계에는 주로 논으로 이용되고 동계에는 대부분의 필지에 양파와 마늘이 고르게 재배되는 지역으로 주로 논에서 양파와 마늘이 재배되는 합천, 창녕군의 재배 특성을 잘 반영하고 있다. 창녕군과 합천군은 서로 인접한 시, 군으로 연구 대상지역의 재배양식은 유사하였는데, 양파의 경우에는 10월말에서 11월초에 정식을 하였으며 마늘은 9월말에서 10월초에 종구를 파종하였다. 투명 비닐을 피복재로 사용하는 것은 동일하였으나 합천의 경우 8구 비닐로 재식 간격이 12 x 18 cm 였으나, 창녕의 경우 6구 비닐로 재식 간격이 15 x 18 cm로 차이가 있었다. 항공영상으로 촬영된 연구대상 지역의 필지별 작물 생육 현황에 대한 현장 조사 결과 합천군 연구대상 지역은 ‘15년의 경우 마늘 102 필지, 양파 79 필지, 하우스, 청보리, 나지 등 기타 33 필지로 총 214 필지였으며, ‘16년의 경우 마늘 99 필지, 양파 64 필지, 기타 13 필지로 총 176 필지였다. 창녕군 연구대상 지역은 ‘15년의 경우 마늘 34 필지, 양파 58 필지, 기타 24 필지로 총 119 필지였으며, ‘16년의 경우 마늘 49 필지, 양파 59 필지, 기타 19 필지로 총 127 필지로 합천의 조사 필지 수가 창녕의 조사 필지 수 보다 많았으며 연차 간에도 조사 필지의 수가 10~30 필지 정도 증감이 있었다.

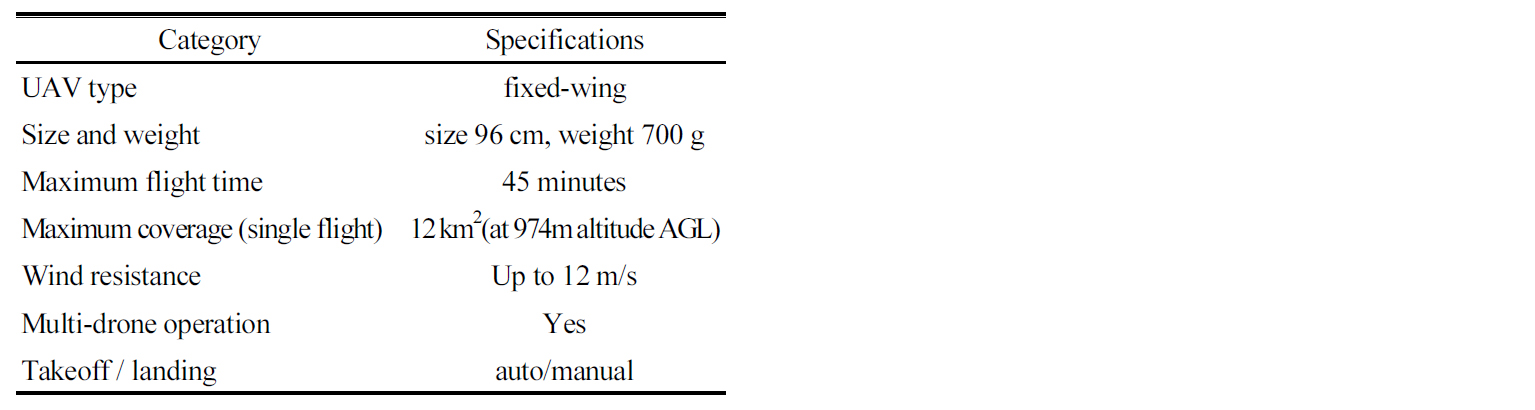

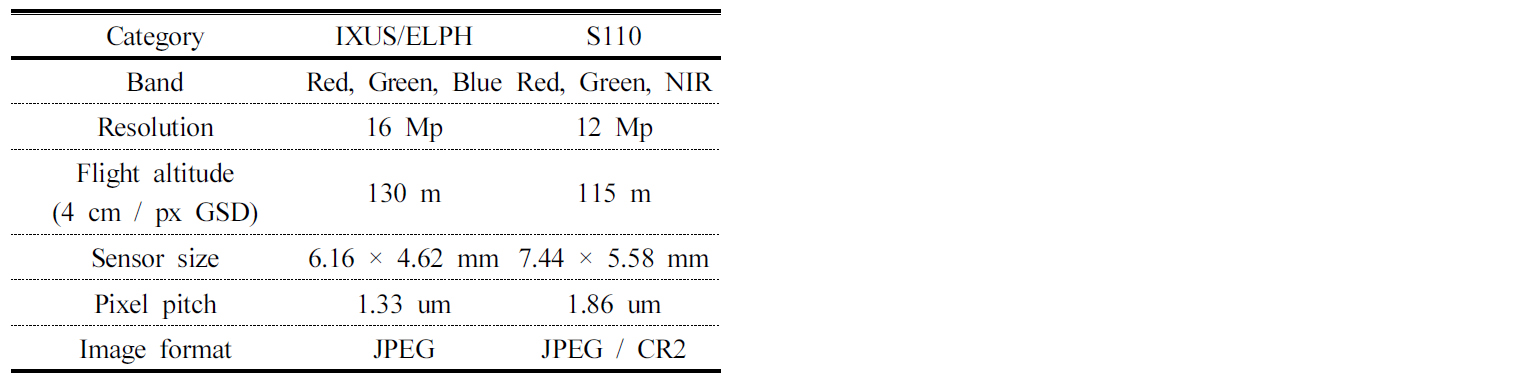

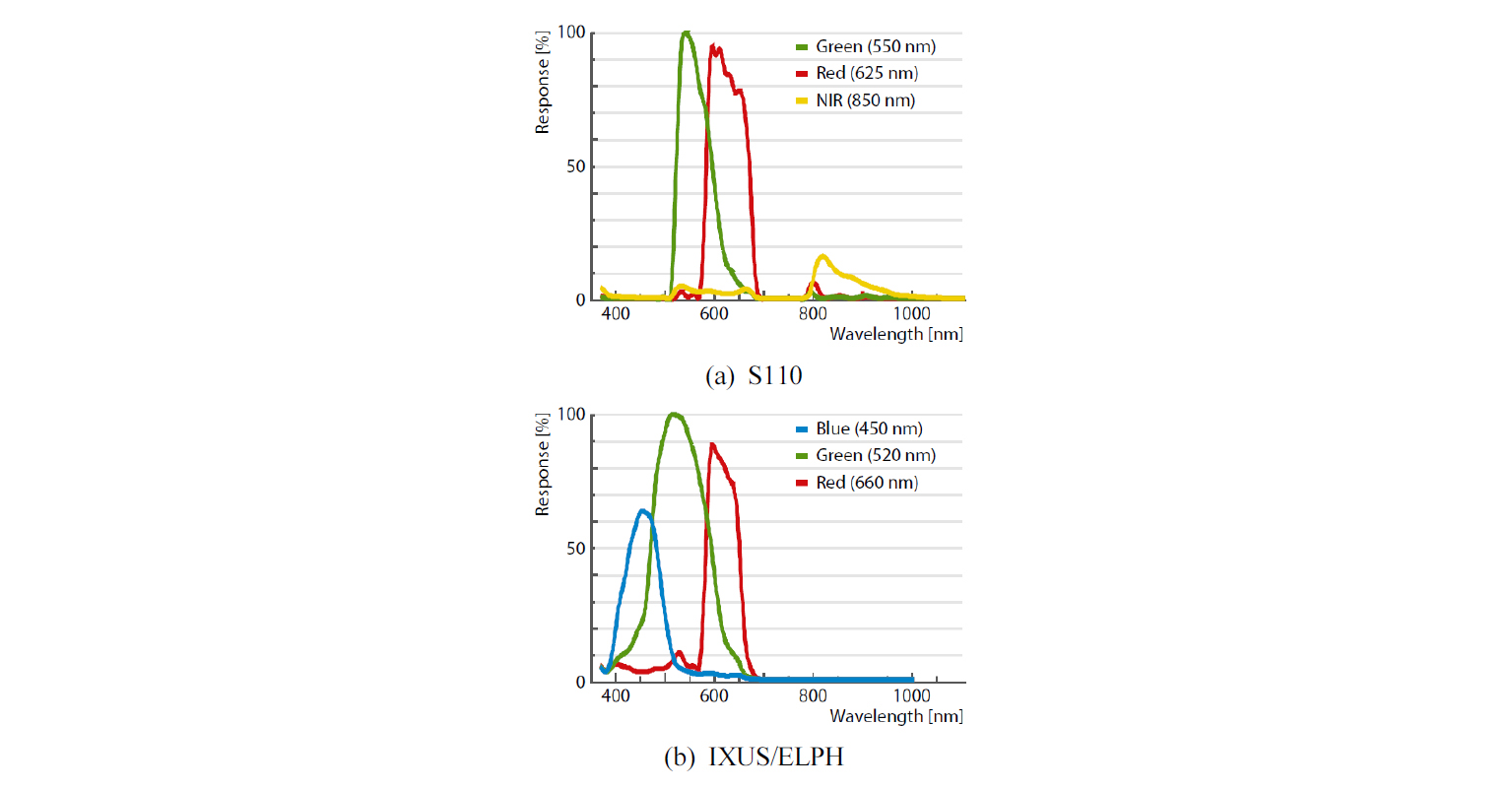

무인기 영상 촬영 및 처리 촬영에 활용한 고정익 무인기 (Ebee, Sensefly, Swiss)의 세부 규격은 Table 1 과 같다. 무인기 Ebee는 비행체의 길이가 96 cm, 무게가 700 g 내외의 소형 경량이며 비행경로 자동 설정 및 자동 착륙 기능이 탑재되어 있어 안전하고 손쉬운 영상 촬영이 가능하다. 두 대의 비행기체를 동시에 운용할 수 있으며, 10여분 내외의 짧은 비행시간으로 촬영면적이 작은 회적익 무인기에 비해 날개가 장착되어 있어 양력을 이용하여 최대 45분 비행으로 고도제한이 없을 경우 1,200 ha의 면적까지 촬영이 가능하다는 점에서는 들녘단위 농경지 촬영에 적합한 기종이다. 무인기 기체에 연결하여 영상을 취득하는 카메라 특성은 Table 2, Fig. 2와 같다. Ebee의 경우 가시광선 영역인 적색 (Red), 녹색 (Green), 청색 (Blue) 영역의 카메라 (IXUS/ELPH, Cannon, Japan, 이하 RGB 카메라)와 적색 (Red), 녹색 (Green), 근적외 (Near Infrared; NIR) 영역을 촬영할 수 있는 카메라 (S110, Cannon, Japan, 이하 NIR 카메라)를 탑재하여 촬영할 수 있는데, 본 연구에서는 천연색 영상으로 농경지 상황을 육안 관찰하기에 효과적인 RGB 카메라와 식생의 무성도 등 생육 상황 분석에 적합한 NIR 카메라를 함께 항공 촬영에 활용하였다.

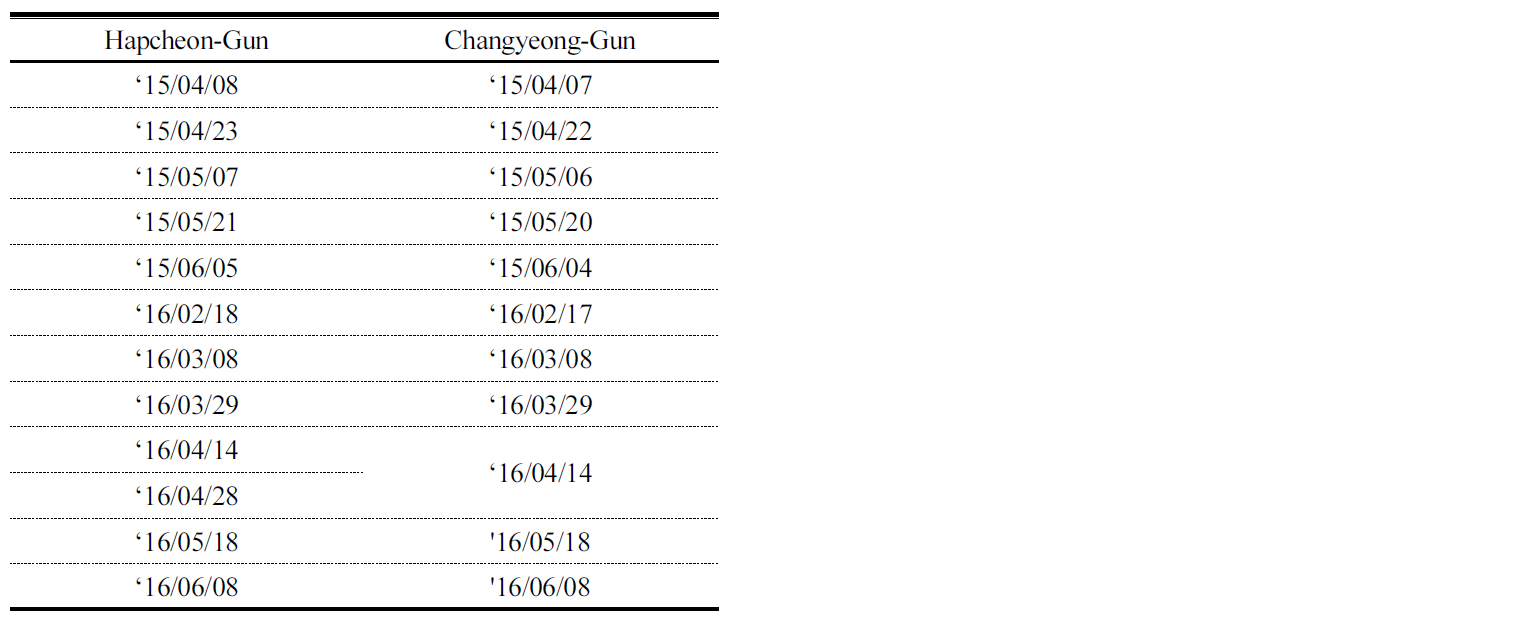

무인기를 활용한 항공영상 촬영은 2015년과 2016년에 걸쳐 2월에서 6월까지 수행되었는데 합천군의 경우 2015년 5회, 2016년 7회의 영상을 획득하였으며, 창녕군의 경우 2015년 5회, 2016년 6회의 영상을 획득하였다 (Table 3). 무인기는 노트북에 설치된 비행시뮬레이션, 비행경로 설정 및 전처리 프로그램 (Emotion, Sensefly, Swiss)을 이용하여 연구대상 지역에서 사전에 해상도 5 cm, 횡중복도 60%, 종중복도 75%로 설정하여 항공영상을 획득하였다. 촬영된 무인기 항공 영상은 촬영 당시 비행체의 고도, 방향 등 위치 정보와 결합한 후 파장영역별 영상 합성 프로그램 (Tera3D, Pix4D, Swiss)을 통해 한 판의 합성영상으로 제작되었다.

영상 감독 분류 및 정확도 산정 영상분류기법이란 영상내의 유사한 특징을 가진 화소들을 하나의 집단으로 구분하여 영상 전체를 제한된 수의 객체 집단으로 구분하는 과정이다 (Lee et al., 2014). 본 연구에서는 주산지에서 양파, 마늘과 기타 토지이용의 구분을 목적으로 함으로 사전에 분류를 목표로 하는 대상을 알고 있을 때 더 효과적으로 분류가 가능한 감독분류 기법을 채택하여 연구를 수행하였다.

감독분류는 사전에 분석자가 알고 있는 화소 집단을 훈련 자료 (training data)로 선정하여 영상의 다른 부분을 분류하는 기법으로, 최소거리법 (Minimum Distance Method), 최대우도법 (Maximum Likelihood Method) 그리고 Mahalanobis방법 등이 주로 사용된다 (Lee and Choi, 2014). 최소거리법에서는 입력 화소로부터 모든 분류 클래스의 훈련 자료에 대한 중심까지의 거리를 계산하여 그 거리가 가장 짧은 분류클래스로 해당 화소의 클래스를 설정한다. 최소거리법은 단순히 훈련 자료의 중심까지의 거리만을 계산하여 분류를 수행하므로 매우 빠르다는 장점을 가지나 훈련 자료의 분포 특성을 고려하지 못한다는 단점을 지니고 있다. 최대우도법은 정규분포를 기본으로 한 확률 밀도 함수에 의한 분류 기법으로서 통계적 분류 기법 중 가장 우수한 성능을 보이는 것으로 알려져 있다. 단, 정규 분포에 의한 학률 밀도 함수를 근간으로 하므로 훈련 자료가 정규 분포의 형태를 보이는 경우에만 우수한 성능을 기대할 수 있다 (Kim et al., 1998). Mahalanobis 방법은 정규분포의 확률밀도함수 가 주어졌을 때 분포의 중심에서 임의점 에 이르는 확률적 거리를 통해 영상을 분류하는 방식으로 넓은 의미의 최소거리법 (MDM)에 해당된다 (Fauvel et al., 2013).

영상 분류의 정확도는 Kappa 계수를 산정하여 평가하였다. Kappa 계수는 카테고리 정보에 대한 평가 항목들 간의 일치도를 측정하는 통계적 지표로서, 완전 불일치인 0으로부터 완전 일치인 1 사이의 값을 갖는다. 여기서, k는 Kappa 계수, Pr(a)는 데이터에서 관찰된 2개 평가항목의 일치 확률, Pr(e)는 2개 평가항목들이 데이터로부터 계산된 확률적으로 일치할 확률을 의미한다 (Mielke and Berry, 2009). 고해상도 영상의 경우 화소 그룹 간 비교적 뚜렷한 차이를 구별할 수 있었던 중·저해상도 영상과 달리 이웃한 화소와의 세밀한 차이까지 구분되어 오히려 오분류 화소까지 분류결과로 표현되는 문제를 발생시키기도 한다 (Ku and Jang, 2006; Van der Sande et al., 2003). 이러한 문제를 해결하기 위해 영상 자료에서 추출한 객체가 아닌 지적도 등 알려져 있는 외부 벡터 자료를 객체로 하여 영상 자료와 통합하여 분류의 정확도를 높이고자 하는 연구 (Ku and Jang, 2006)가 시도되어 작업의 기준이 되는 지적도 등이 정확할 경우 효과적인 결과를 얻을 수 있다고 하였다. 본 연구에서는 농림축산식품부에서 ‘14년부터 ‘16년까지 전국의 농경지 경계 지도를 25 cm 급 항공영상으로 제작하는 스마트 팜 맵 사업의 기 구축성과물을 필지의 벡터로 사용하여 필지별로 가장 많은 분류 화소 값 (Majority)을 그 필지의 토지이용으로 정함으로써 고해상도 영상 사용에 따른 오분류 오차를 줄이도록 하였다. 무인기 영상의 감독분류는 Leica사의 Erdas Imagine 프로그램을 이용하여 수행하였는데, 창녕군 연구대상지역은 15, ‘16년 공히 양파 5필지, 마늘 5필지, 기타 (하우스 3, 나지 5, 기타 3) 11필지를 사전에 알고 있는 샘플(ROI: Region of Interest)로 선정하였다. 합천군 연구 대상지역의 경우 ‘15년에는 5필지, 마늘 5필지, 기타 (하우스 5, 나지 5, 기타 5) 15필지, ‘16년에는 양파 5필지, 마늘 5필지, 기타 (하우스 5, 나지 3, 기타 1) 9필지를 ROI로 선정하여 감독분류를 수행하였다.

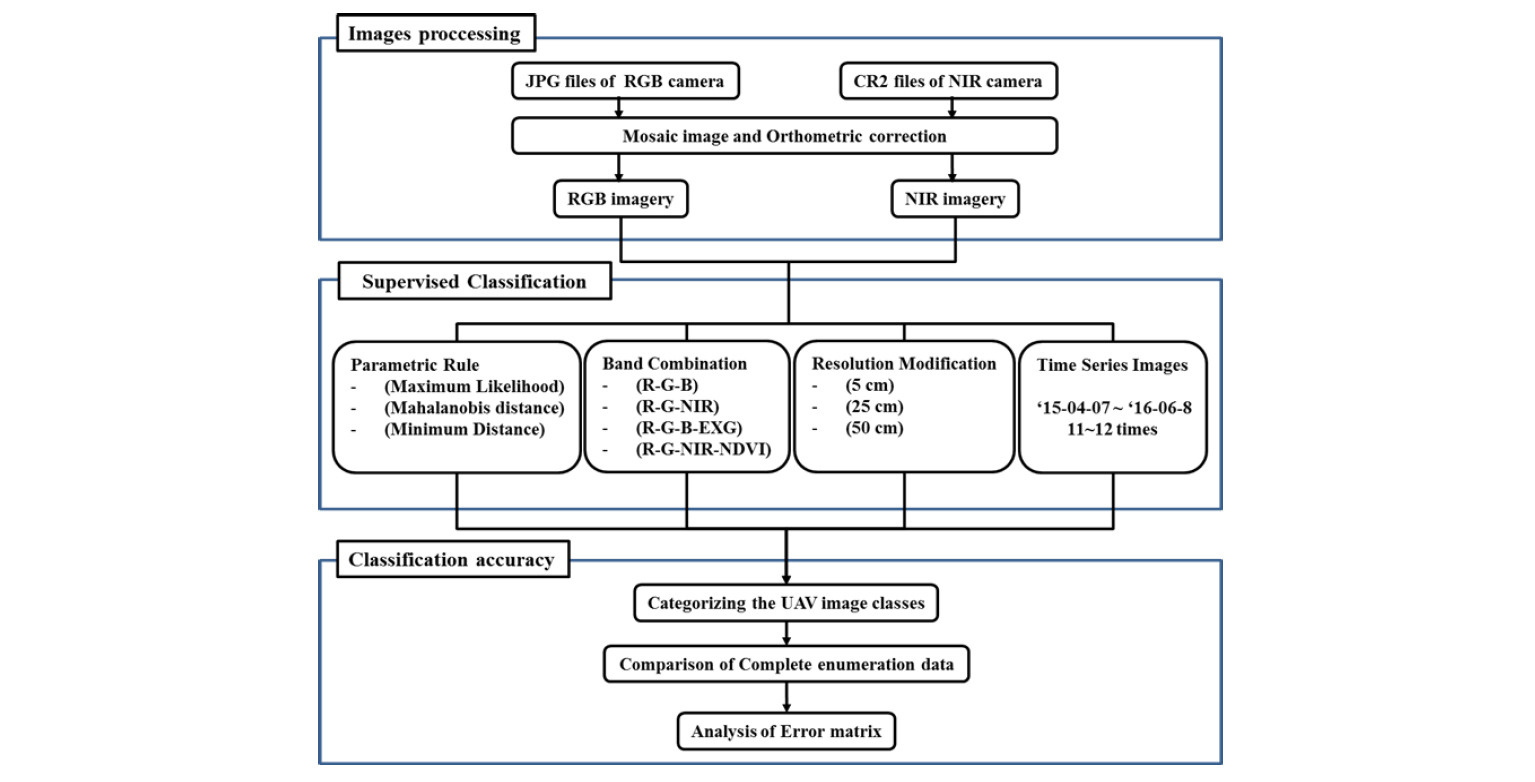

영상 감독 분류 방법별 정확도 비교 무인기 영상의 감독 분류 정확도 비교 수행 과정은 Fig. 3과 같다. 창녕군과 합천군의 연구대상지역에서 동일 날짜에 촬영된 ‘16년 3월 8일 및 ‘16년 5월 18일 영상을 대상으로 감독분류 기법인 최소거리법, 최대우도법 그리고 Mahalanobis방법별로 정확도를 비교하였다. 이후 선택된 감독분류 기법을 활용하여 합천군 연구대상 지역에서 촬영된 ‘16년 3월 8일 및 ‘16년 5월 18일 영상을 대상으로 원영상에 식생지수를 결합하여 레이어 수를 증가시켜 분광해상도를 향상시켰을 때의 정확도를 비교하였다. 즉, 본 연구에 사용된 무인기 카메라의 경우 R-G-B, 또는 R-G-NIR 등 3개 밴드만을 이용하여 영상을 촬영하고 있어 이들 영상을 조합하여 만들 수 있는 식생지수를 결합하였을 때 분류 정확도가 향상될 수 있는지 분석하였다. 여기서, ρNIR 은 근적외선밴드의 스펙트럼 반사율이며,  는 적색밴드의 스펙트럼 반사율이다. 여기서, r, g, b는 각각 적색, 녹색, 청색 밴드 값 총합에 대한 적색, 녹색, 청색 밴드 값의 비율이다.

는 적색밴드의 스펙트럼 반사율이다. 여기서, r, g, b는 각각 적색, 녹색, 청색 밴드 값 총합에 대한 적색, 녹색, 청색 밴드 값의 비율이다.

(Eq.1)

(Eq.1)

(Eq.2)

(Eq.2)

본 연구에서 사용된 무인기 영상의 경우 5 cm의 공간해상도를 가지고 있어 매우 정밀하나 이로 인해 농경지에서 작물 이외의 비닐 피복재 등 타 토지피복의 간섭효과가 클 수 있을 것으로 판단되어 합천군에서 촬영된 ‘16년 3월 8일 및 ‘16년 5월 18일 영상을 대상으로 공간 해상도를 25 cm와 50 cm로 확대하여 감독 분류를 수행하고 정확도 향상 유무를 분석하였다. 또한, 작물에 대한 감독 분류 결과는 작물의 종류 및 재배 형태, 생육 상황 등에 따라 시기별로 다를 수 있음으로 합천군과 창녕군의 연구 대상지역에 촬영된 전 영상을 대상으로 위에서 선정된 감독분류 기법, 분광해상도, 영상의 격자크기를 적용하여 시기별로 감독분류를 수행하고 정확도를 비교하였다.

Results and Discussion

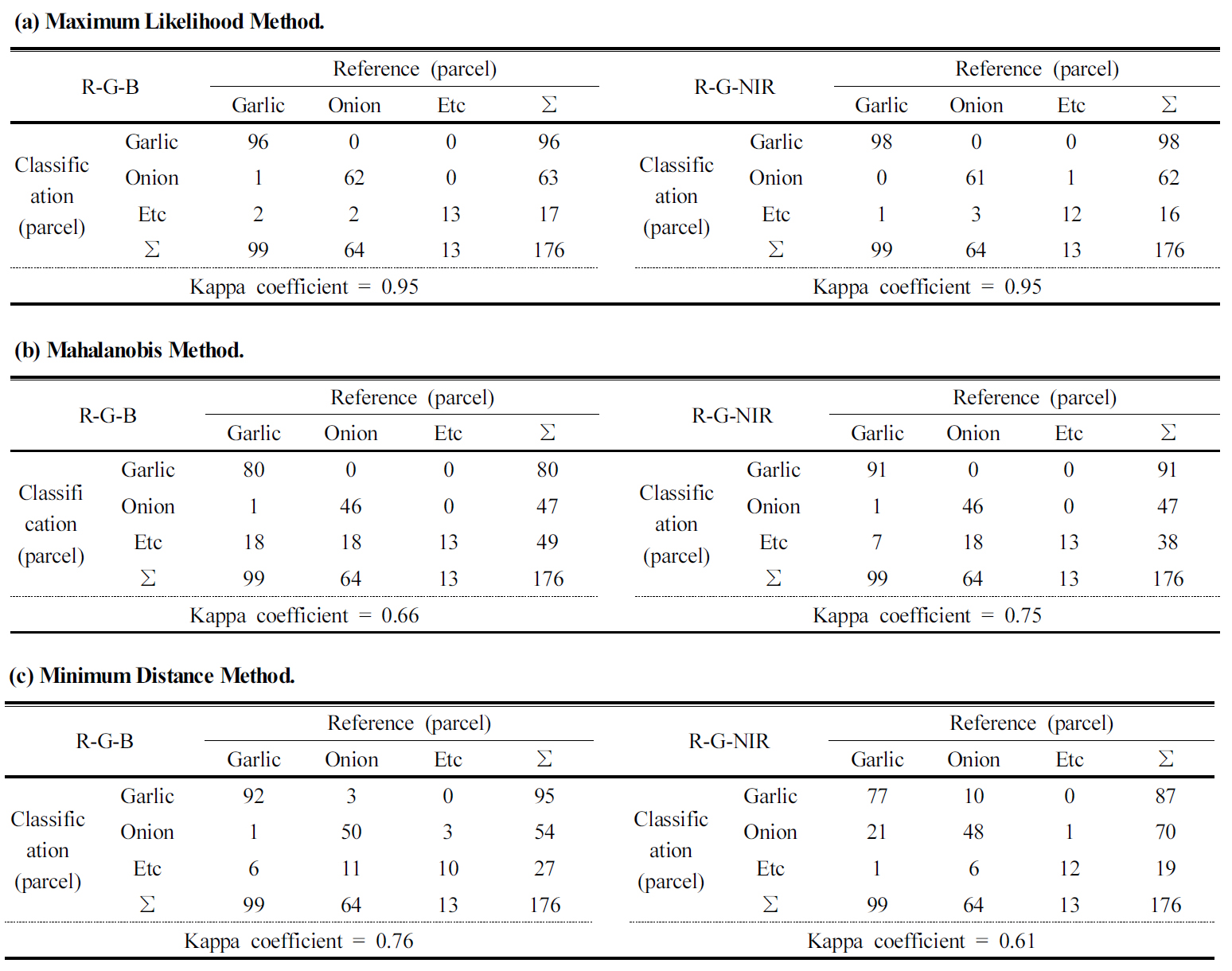

‘16년 5월 18일 합천군의 연구대상 지역에 대한 감독분류 기법별 농경지 필지의 작물 분류 정확도 분석 사례는 Table 4와 같았다. 최대우도법의 경우 R-G-B 및 R-G-NIR 밴드 영상에서 모두 Kappa 계수 0.95로 다른 방법에 비해 가장 높은 정확도를 보였다. 양파 99필지와 마늘 64필지 중에서 1~3개 필지가 영상 감독분류에서 기타로 분류된 것이 오차의 주요한 원인이었다. Mahalanobis법의 경우 R-G-B 및 R-G-NIR 밴드 영상의 Kappa 계수가 각각 0.66, 0.75의 값을 보였다. R-G-B 밴드 영상의 경우 마늘이 기타로 영상 감독분류에서 오분류 된 것이 전체 99필지에서 18개 필지였으며, 양파의 경우에도 전체 64필지 중에서 19개 필지가 기타로 오분류 되어 양파, 마늘이 과다하게 기타 필지로 분류된 것을 확인할 수 있었다. R-G-NIR 밴드 영상의 경우 마늘이 기타로 분류되는 필지가 R-G-B 밴드에 비해서 숫자가 줄었으나 양파의 경우 18개 필지가 기타로 오분류 되어 R-G-B 밴드와 동일한 경향을 보였다. 최소거리법의 경우 R-G-B 및 R-G-NIR 밴드 영상의 Kappa 계수가 각각 0.76, 0.66의 값을 보였다. Mahalanobis법에 비해 양파 - 마늘, 양파 - 기타, 마늘 - 기타 간의 오분류가 상호 증가하는 경향을 보였다.

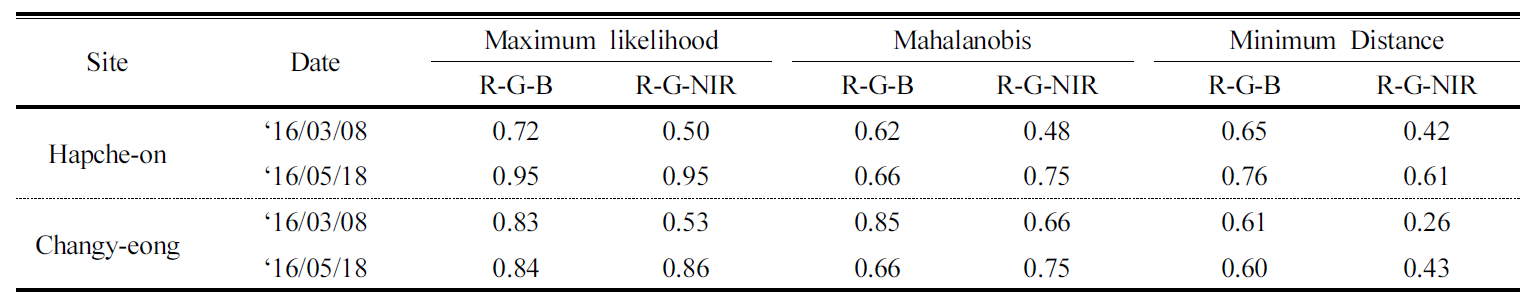

합천군과 창녕군 연구대상지역의 ‘16년 3월 8일과 5월 18일 감독분류 기법별 Kappa 계수를 정리한 것은 Table 5와 같았다. 영상 감독분류 기법 중에서 최대우도법으로 분류한 결과의 Kappa 계수가 3월 8일 창녕군 연구대상지역에 대해 R-G-NIR 영상 밴드로 분류한 결과를 제외하고 Mahalanobis 및 최소거리법에 비해 모두 높은 값을 보여 가장 우수한 성능을 보인 것으로 판단된다.

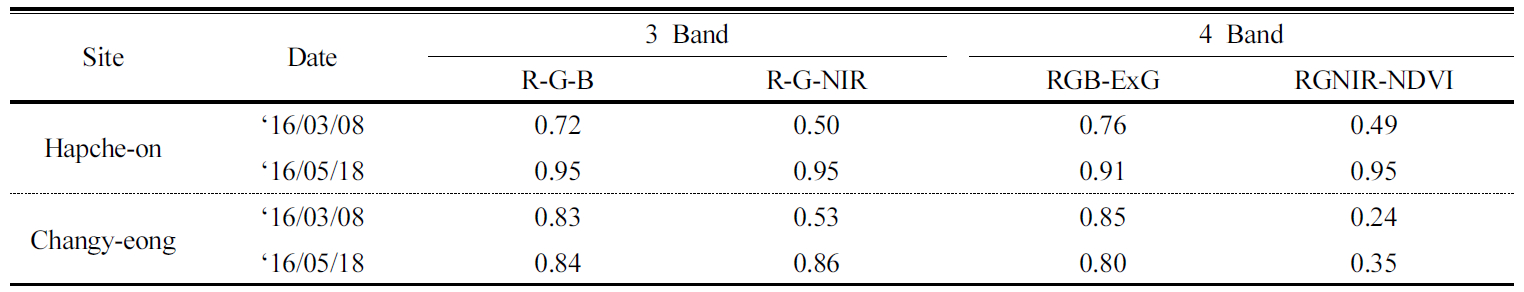

합천군 연구대상 지역에서 촬영된 ‘16년 3월 8일 및 ‘16년 5월 18일 영상에 대하여 원영상에 식생지수를 결합하여 레이어 수를 증가시켜 분광해상도를 향상시킨 후 최대우도법으로 감독분류한 결과의 Kappa 계수는 Table 6과 같았다. R-G-B, R-G-NIR 영상에 비해 식생지수 영상을 결합한 영상의 Kappa 계수는 ‘16년 3월 8일 R-G-B 밴드 영상을 제외하고는 증가 경향을 보이지 않았다.

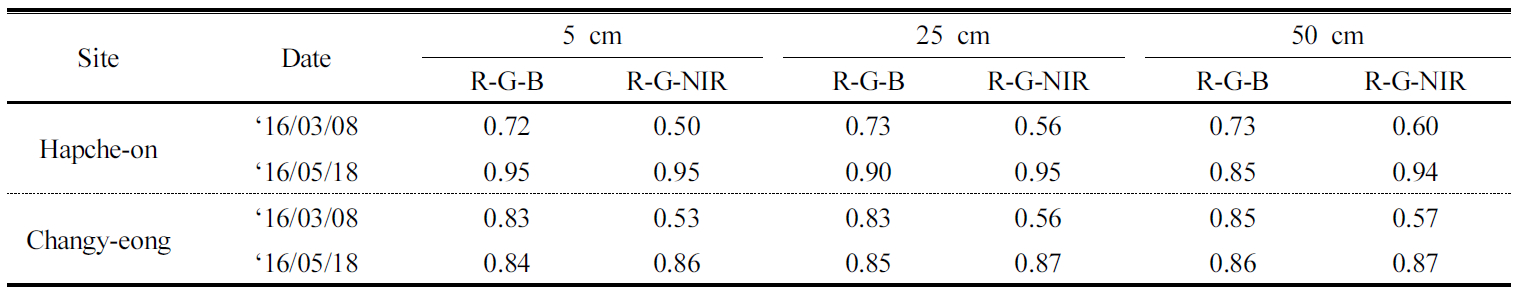

합천군 연구대상 지역에서 촬영된 ‘16년 3월 8일 및 ‘16년 5월 18일 영상에 대하여 원영상의 공간해상도를 5배, 10배 증가 시킨 후 최대우도법으로 감독 분류한 결과의 Kappa 계수는 Table 7과 같았다. ‘16년 3월 8일의 경우에는 공간해상도가 증가할수록 R-G-NIR 영상의 감독분류 결과의 Kappa 계수가 0.06~0.1까지 증가하였으나 ‘16년 5월 18일의 경우에는 오히려 감소하는 경향을 보여 무인기 영상의 공간해상도 증가가 영상분류 정확도에 일정하게 미치는 영향을 확인할 수 없었다.

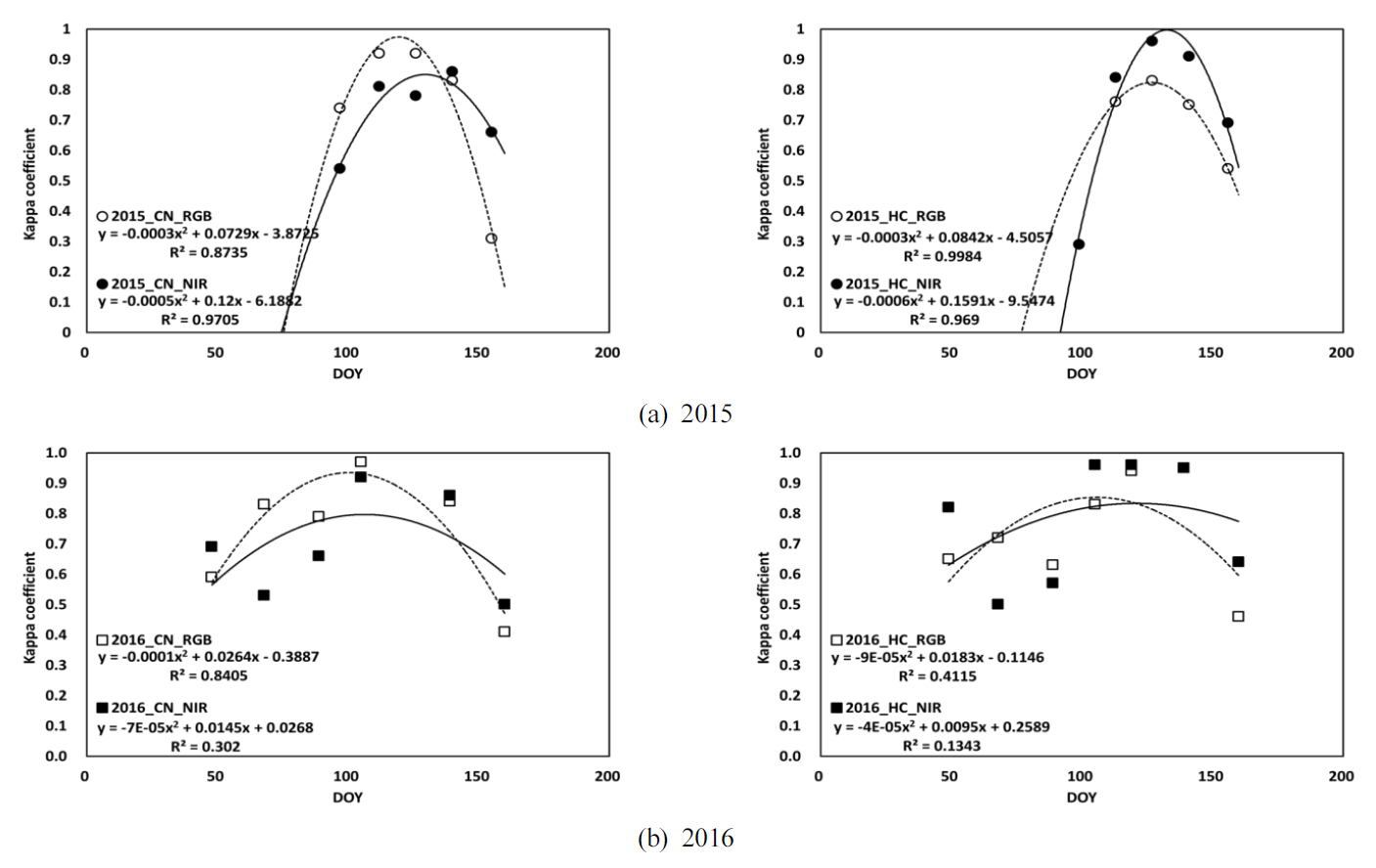

2015년과 2016년 연구대상 지역에 대한 시기별 R-G-B 밴드 및 R-G-NIR 밴드 영상의 최대우도법으로 수행한 감독분류 결과 Kappa 계수 변화는 Fig. 4와 같았다. 양파, 마늘이 겨울 이후 재생기를 거쳐 성장하면서 엽색이 짙어지고 왕성하게 성장하는 DOY 110일 이후에 Kappa 계수가 0.8~0.9 내외로 높아졌다가 수확기에 접어들면서 다시 감소하는 경향을 보였다. 창녕군 연구대상 지역 영상의 경우 2015년에는 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수가 DOY 112일과 126일에 0.92로 가장 높은 값을 보였으며, R-G-NIR 밴드 영상의 경우 DOY 140일에 0.86으로 가장 높은 값을 보였다. R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수는 0.31~0.92의 범위를 보여 R-G-NIR 밴드 영상으로 분류한 결과의 범위 0.54~0.86에 비해 수확기를 제외하고는 대체적으로 더 높은 값을 보였다. 합천군 연구대상지역의 경우에는 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수가 DOY 127일에 0.83으로 가장 높은 값을 보였으며, R-G-NIR 밴드 영상의 경우 DOY 127일에 0.96으로 가장 높은 값을 보였다. 합천군 연구대상지역의 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수 값은 0.54~0.83 범위로 R-G-NIR 밴드 영상으로 분류한 결과 0.29~0.96에 비해 대체적으로 낮은 경향을 보여 창녕군과는 다른 결과를 보였다.

2016년에는 창녕군 연구대상 지역 영상의 경우 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수가 DOY 105일에 0.97로 가장 높은 값을 보였으며, R-G-NIR 밴드 영상의 경우 DOY 105일에 0.92으로 가장 높은 값을 보였다. R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수는 0.41~0.97의 범위를 보여 R-G-NIR 밴드 영상으로 분류한 결과의 범위 0.5~0.92에 비해 DOY 100일 이전에는 R-G-B 밴드 영상으로 분류한 Kappa 계수 결과가 R-G-NIR 밴드 영상에 비해 높았으나 DOY 100일 이후에는 대체적으로 유사한 결과를 보였다. 합천군 연구대상지역의 경우에는 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수가 DOY 139일에 0.95로 가장 높은 값을 보였으며, R-G-NIR 밴드 영상의 경우 DOY 105일과 119일에 0.96으로 가장 높은 값을 보였다. 합천군 연구대상지역의 R-G-B 밴드 영상으로 분류한 결과의 Kappa 계수 값은 0.46~0.95 범위로 R-G-NIR 밴드 영상으로 분류한 결과 0.5~0.96에 비해 DOY 100일 이전에는 R-G-B 밴드 영상으로 분류한 Kappa 계수 결과가 R-G-NIR 밴드 영상에 비해 높았으나 DOY 100일 이후에는 대체적으로 유사한 결과를 보여 창녕군과 같은 경향을 보였다.

토지피복에 대한 감독분류 결과는 영상 촬영 당시의 기상, 광 조건 등 촬영환경, 식생의 생육 변동에 따른 분광반사 변화 특성 및 분류 대상체의 분포 비율 등 다양한 요인에 영향을 받는다. 따라서 동일한 대상 작물에 대해서 연차, 지역 및 분광 밴드를 다르게 하여 항공영상을 촬영할 경우에도 분류하고자 하는 대상 작물의 구성 비율과 기타로 분류되는 토지피복의 종류 및 특성이 달라지므로 감독분류 결과는 다를 수 있다. 본 연구에서도 R-G-B 밴드 영상과 R-G-NIR 밴드 영상 간의 감독 분류 정확도 비교는 대상 지역 및 연차간의 특성이 달라 뚜렷한 판단을 내릴 수 없었다. 그러나 2년 동안 양파, 마늘의 구성 비율이 서로 다르고 기타 토지이용이 상이한 2지역에 대하여 무인기 영상의 R-G-B 밴드와 R-G-NIR 밴드로 감독분류를 실시한 결과 DOY 105일에서 141일까지 Kappa 계수가 0.75~0.97의 범위로 평균 0.88의 매우 높은 정확도를 보여 (Landis and Koch, 1977) 무인기 영상은 양파, 마늘 주산지 작물의 자동분류 및 재배면적 추정에 적용 가능성이 있을 것으로 판단된다. 추후에는 추가적인 무인기 영상 촬영과 현장 조사를 통해 영상 감독 분류 결과에 영향을 주는 촬영, 재배 환경 변화의 정량적 연관성 해석과 조기 작물 구분을 위한 영상 촬영 시기별 오차 범위 규명 및 주산지 영상 감독 분류의 확대 적용 가능성에 대한 연구가 수행되어야 할 것으로 판단된다.

Conclusions

양파, 마늘 주산지에 대한 무인기 영상의 감독분류 기법 및 시기별 분류 정확도를 평가하여 양파, 마늘 재배면적 산정을 위한 무인기 영상의 자동 분류 기법 적용 가능성 평가를 위해 양파, 마늘 재배면적이 각각 10위 안에 드는 창녕군과 합천군의 연구대상 지역을 선정하여 2015년과 2016년 영농기 동안 무인기를 활용해 R-G-B 밴드 영상과 R-G-NIR 밴드 영상을 각각 11~12회 촬영하고 Kappa 계수를 산정하여 정확도를 비교하였다. 그 결과, 감독분류 기법으로는 최대우도법이 Mahalanobis 및 최소거리법에 비해 분류 성능이 뛰어 났으며 무인기 영상의 분광해상도 및 공간해상도는 분류 결과에 큰 영향을 주지 않았다. 촬영 시기별로는 DOY 105일에서 141일까지 Kappa 계수가 0.75~0.97의 범위로 평균 0.88의 높은 정확도를 보여 무인기 영상을 활용한 양파, 마늘 주산지 작물 구분 및 재배면적 추정에 적용 가능성이 있을 것으로 판단된다. 추후에는 영상 감독 분류 결과에 영향을 주는 촬영, 재배 환경 변화의 정량적 연관성 해석, 조기 작물 구분을 위한 영상 촬영 시기별 오차 범위 규명 및 주산지 영상 감독 분류의 확대 적용 가능성에 대한 연구가 수행되어야 할 것으로 판단된다.